海角社区 免费视频

- 发布日期:2024-12-05 20:35 点击次数:88

金磊 发自 拉斯维加斯淫色

量子位 | 公众号 QbitAI

就在刚刚,云计较一哥亚马逊云科技,在大模子这件事儿上搞了波大的——

亚马逊CEO Andy Jassy躬行站台re:Invent24,发布自家新款AI多模态系列大模子,名曰Amazon Nova。

而且是连气儿涵盖文本对话、图片生成、视频生成,致使凯旋吐露一个小运筹帷幄:

改日咱们不仅要Speech to Speech,更要Any-to-Any!

举座而言,Amazon Nova系列中的统统模子,均以功能和尺寸来分手。

先来看下新版顶端基础大模子的“文本对话篇”,一共包含四个杯型:

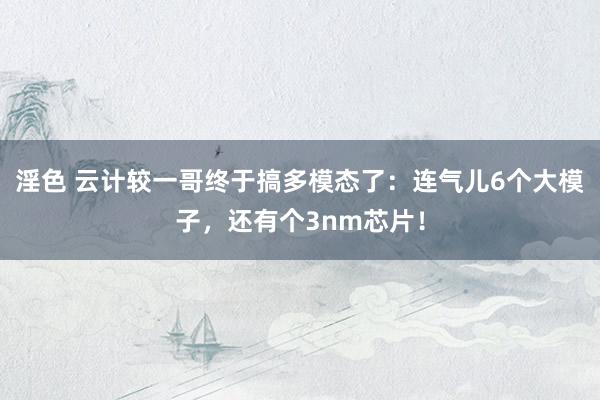

Amazon Nova Micro:仅限文本对话,主打一个廉价钱和低蔓延;Amazon Nova Lite:低本钱的多模态大模子,处理图像、视频和文本输入的速率极快。Amazon Nova Pro:高性能的多模态大模子,精度、速率和本钱最好“配方”,可处理平日的任务。Amazon Nova Premier:亚马逊最强多模态大模子,可处理复杂的推理任务,也可用于蒸馏客户定制化的模子。在现场,Andy也晒出了Amazon Nova在CRAG、BFCL、VisualWebBench和Mind2Web等Benchmarks上赢得的分数。

从得益中不出丑出,其在检索增强生成(RAG)、函数调用和智能体应用方面具有较好的性能。

据悉,前三者还是上架亚马逊云科技的“模子工场”Amazon Bedrock,而Premier版块则将于2025年第一季度推出。

面前也有一些实测还是流出,举例给Amazon Nova Pro一句Prompt:

Write a summary of this doc in 100 words. Then, build a decision tree.

写一篇100字的摘抄。然后,构建一个决策树。啪的一下,拔除就出来了:

再如让Amazon Nova Pro相识底下这个归并在沿途的视频:

它给出的谜底是:

The video begins with a view of a rocky shore on the ocean, and then transitions to a close-up of a large seashell resting on a sandy beach.

视频一启动是海洋上的岩石海岸,然后过渡到一个大贝壳躺在沙滩上的特写。

接下来,就是“非文本生成篇”,一共包括两款。

Amazon Nova Canvas,主打的是图像生成,用官方的话来说,是达到了“State-of-the-art”(起原进)的水平:

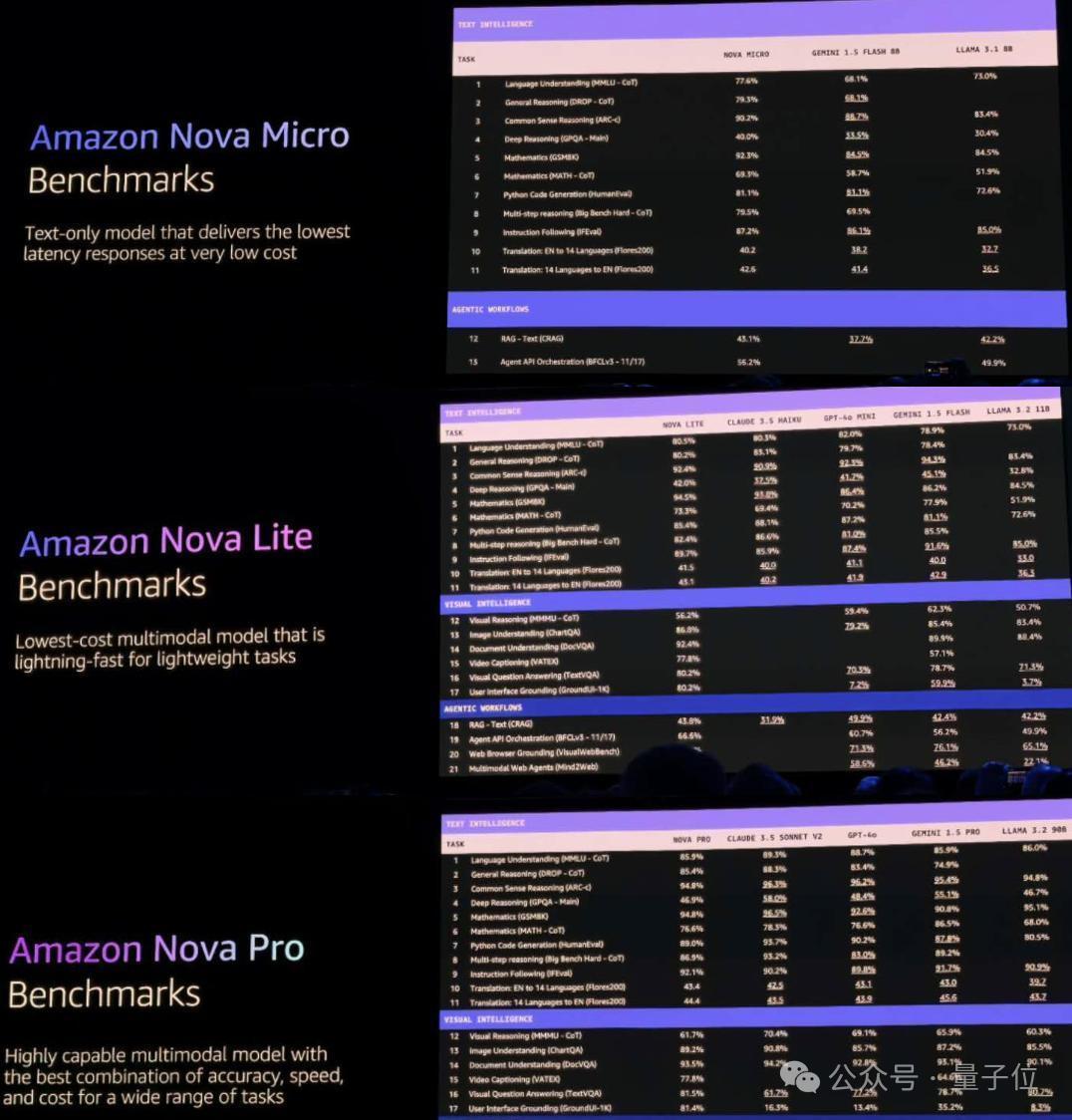

至于视频生成模子,名叫Amazon Nova Reel,给定一张图片和一句话,即可让它动起来:

而接下来Andy的一番话,凯旋让现场不淡定了。

正如咱们刚才提到的,Andy还是放出了话,Amazon Nova行将呈现出来的态势是万物齐可生成。

值得细细品尝的少量是,亚马逊云科技在生成式AI时期中,先前发布自研大模子并不算最吸睛的那一批。

天然此前也发布过Amazon Titan大模子,但模态上也仅限于文本,更多的元气心灵照旧聚焦在了像Amazon Bedrock、Amazon Q这么的平台和应用。

而这次,亚马逊云科技却一反常态,以动须相应之势把主流模态全面粉饰,致使一句“Any-to-Any”彰显其弘愿。

为何会如斯?

纵不雅整场发布会,透过亚马逊云科技CEO Matt Garman的全程先容,大概不错把谜底总结为——

实力是一直有的,仅仅面前客户有需求了。

△Matt Garman初次以CEO身份参加re:Invent

这又该怎么相识?咱们接续往下看。

算力再升级,价钱很鲜艳先看实力。

当作云计较一哥,算力是亚马逊云科技的看家才能之一。

与传统云就业厂商不同,其自主研发并优化的专用芯片和数据中心,包括Graviton和Nitro等特有就业器主机,为及时计较提供接济。

而这一次,从芯片到就业器,基础设施上一系列的更新动作,不错分为三大板块来看——

计较(Compute)、存储(Storage)和数据库(Database)。

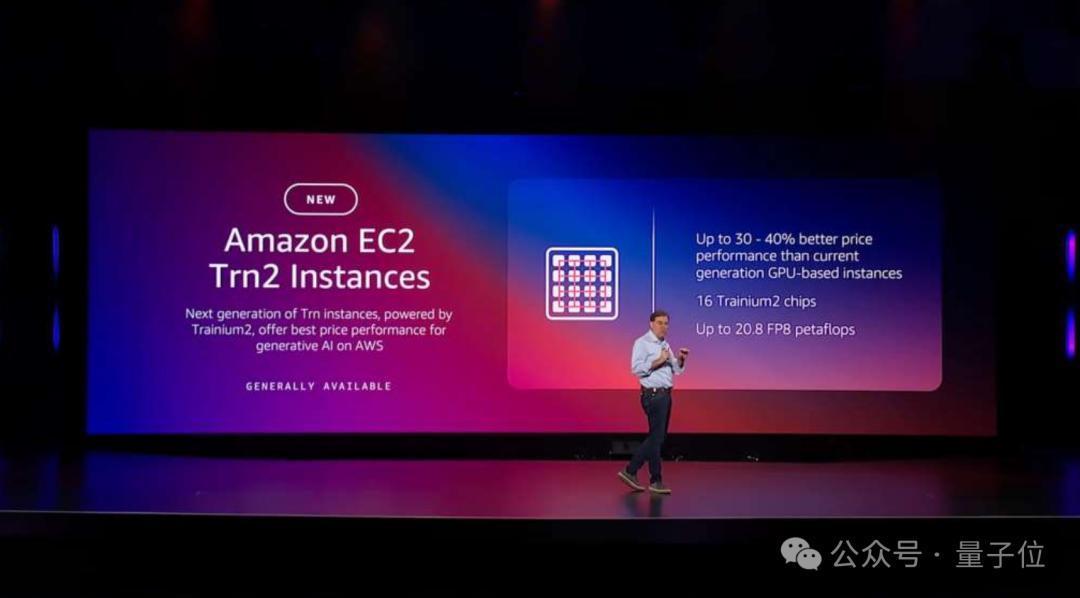

在计较层面上,亚马逊云科技先是晓谕Amazon EC2 Trn2实例风雅可用。

EC2 Trn2实例遴荐了第二代Trainium 芯片(Trainium2),与上一代Trn1实例比较,性能普及权贵。具体来说:

放哨速率提高4倍:这一性能普及能有用减少模子放哨所需时辰,加速企业应用落地;内存带宽提高4倍:更强的数据传输智力不错满足复杂模子对及时数据处理的高条件;内存容量提高3倍:为高参数目模子的运行提供了填塞的计较资源。此外,Trn2实例在性价比上比刻下基于GPU的EC2 P5e和P5en实例跨越30-40%。

每个Trn2实例包含16个Trainium2芯片,192 vCPUs,2 TiB的内存,以及3.2 Tbps的Elastic Fabric Adapter (EFA) v3 集聚带宽,这比上一代申斥了高达 35% 的蔓延。

针对更高性能需求,亚马逊云科技同期推出了Trn2 UltraServer。

这是一种全新的超大范畴计较居品,每台UltraServer包含64个Trainium2芯片,并通过高带宽、低蔓延的 euronLink互连兑现了超卓的性能。

这使得Trn2 UltraServer成为放哨超大范畴基础模子(如生成式 AI、LLM 等)的逸想取舍。

euronLink是亚马逊云科技特有的集聚互连技巧,它能够将多台Trainium就业器组合成一个逻辑上的单一就业器,团结带宽可达2TB/s的带宽,而蔓延仅为1微秒。

它的联想额外相宜散布式深度学习任务,在集聚通讯上的优化有助于权贵镌汰放哨时辰,普及资源诈欺率。

用官方的话来说就是:

这恰是放哨万亿级参数的大型东说念主工智能模子所需要的超等计较平台,相当普遍。

欧美av女星

在现场,苹果也来为亚马逊站台,机器学习和东说念主工智能高档总监Benoit Dupin暗意:

苹果将使用亚马逊云科技的Trainium2芯片。

除此除外,在芯片层面上,亚马逊云科技发布了AWS Trainium3芯片预览版,展望于2025年风雅推出。

据悉,Trainium3将遴荐3纳米工艺制造,提供两倍于Trainium2的计较智力,并普及40%的能效。

在计较(Compute)之后,即是存储(Storage)上的更新。

咱们都知说念,在数据分析和大数据领域,处理和查询大范畴数据集的智力至关蹙迫。

而传统的数据查询方法在处理海量数据时,时常导致性能瓶颈和管制复杂性,影响了企业的数据驱动决策智力。

为此,亚马逊云科技特意推出了Amazon S3 Tables。

Amazon S3 Tables提供了一种新的存储神志,专为表格数据联想,接济使用Amazon Athena、Amazon EMR 和 Apache Spark等流行的查询引擎进行狂放查询。

S3的表存储桶是它的第三种存储桶类型,与现存的通用存储桶和目次存储桶比肩;不错将表存储桶视为一个分析仓库,用于存储具有不同格局的Iceberg表格。

与自管制的表格存储比较,S3 Tables不错兑现高达3倍的查询性能普及和10倍的每秒事务处明智力,同期提供全托管就业的操作成果。

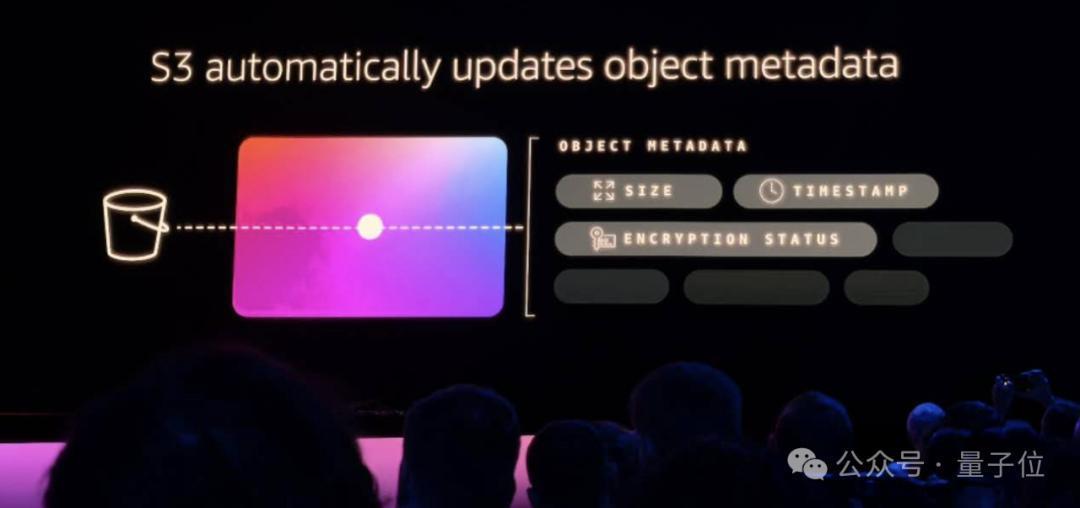

除此除外,元数据(Metadata)也变得越发蹙迫,举例电话内部有好多像片,恰是因为通过元数据储存数据,面前不错兑现用天然话语很快找到这张像片。

基于这么的需求,亚马逊云科技推出了Amazon S3 Metadata的预览版。

Amazon S3 Metadata提供了一种自动化、易于查询的元数据管制神志,这些元数据简直及时更新,匡助用户整理、识别和使用S3数据进行业务分析、及时推理当用等。

它接济对象元数据,包括系统界说的详实信息(如大小和对象来源)以及自界说元数据,允许用户使用标签为对象添加居品SKU、来回ID或实践评级等信息。

而这些元数据通常也存储在S3 Tables之中。

在计较、存储之后,即是基础设施的第三大板块——数据库(Database)。

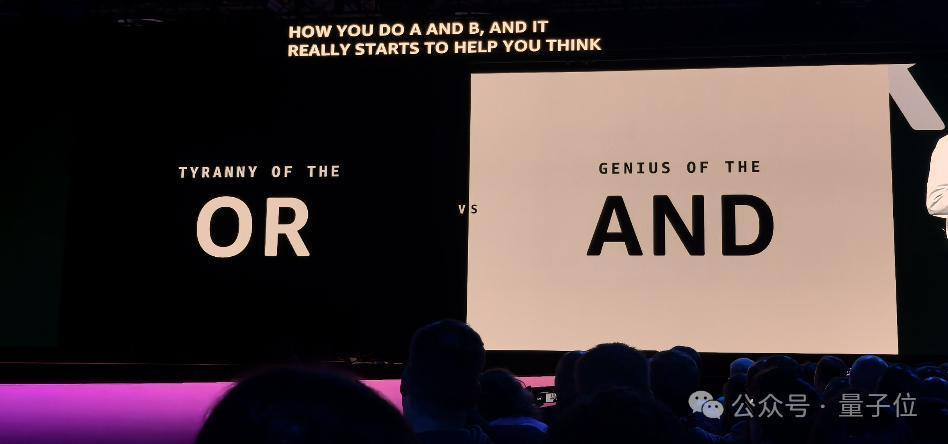

故意料的少量是,Matt在现场共享了一张“OR”照旧“AND”的图,暗意企业在取舍数据库时大都遭遇的发奋抉择——跨区域一致、高可用性、低蔓延,经常只可3选2。

而亚马逊云科技这次给出的答卷是,都不错有。

这就是新式无就业器散布式数据库Amazon Aurora DSQL,旨在处治传统数据库在扩张性和性能方面的挑战。

Aurora DSQL结合了传统关总共据库的强一致性和NoSQL数据库的散布式扩张智力,提供了以下几个要津上风:

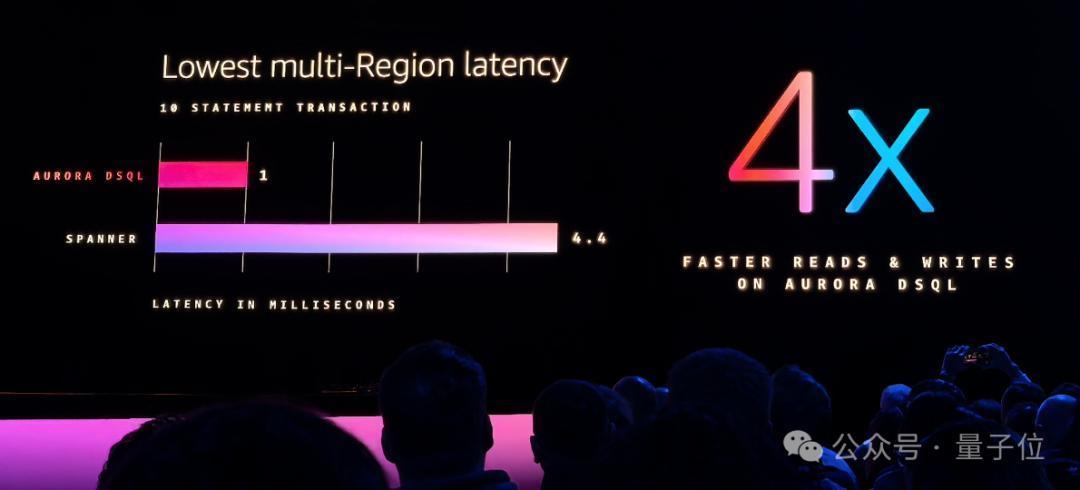

跨区域强一致性和低蔓延:遴荐了全新的架构,使其能够在多个地舆区域中同期运行,而保执强一致性。无尽扩张:能够处理数TB到数PB级的数据集,适用于任何范畴的企业。超高可用性:提供99.999%的可用性,这对于许多需要高可用性和无缝运行的企业级应用至关蹙迫。性能优厚:其跨区域的读写操作比Spanner快了四倍。

以上即是亚马逊云科技这次在基础设施上的发力了。

新的积木——推理如果说把基础设施的三大板块视为三块积木,那么接下来,亚马逊云科技在模子层和应用层方面添加了第四块积木——推理(Inference)。

推理是生成式AI使命流的中枢,它指的是将还是放哨好的模子应用到新数据上,进行预测、生成或推断。

Matt在会上强调:

推理在AI模子的应用中变得尤为蹙迫,尤其是在处理像大型话语模子等复杂模子时,推理条件极高的计较智力和低蔓延反应。

而Amazon Bedrock当作亚马逊云科技在模子层的一项AI平台就业,先是与咱们上述的基础设施在推理上保执了同步。

换言之,Inferentia和Trainium芯片提供的推理的硬件优化,用户不错通过Amazon Bedrock毛糙造访这些资源。

而至于Amazon Bedrock自己,这次也迎来多项智力的升级。

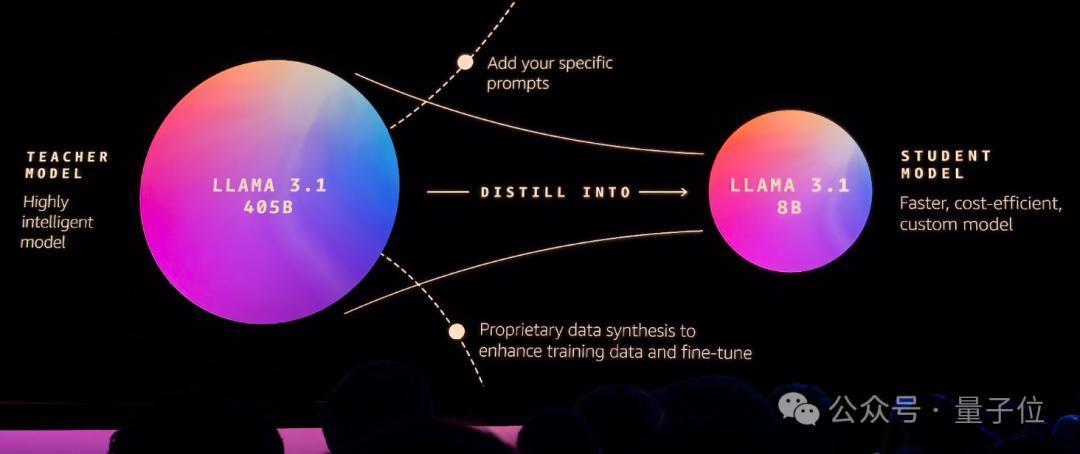

当先就是模子蒸馏(Model Distillation),能够自动化创建针对特定用例的蒸馏模子。

主如果通过从大型基础模子(安祥模子)生成反应,并使用这些反应来微调较小的基础模子(学生模子),从而兑现常识漂泊,提高小模子的精准度,同期申斥蔓延和本钱。

其次是多智能体合作(multi-agent collaboration)。

在需要多个智能体处理复杂任务的场景中,管制这些智能体变得具有挑战性,尤其是跟着任务复杂性的加多。

使用开源处治决策的开荒者可能会发现我方需要手动兑现智能体编排、会话处理、内存管制等复杂操作。

这也恰是亚马逊云科技在Amazon Bedrock上推出多智能体合作的起点。具体特质如下:

快速设立:无需复杂编码,几分钟内创建、部署和管制协同使命的AI智能体。可组合性:将现存智能体当作子智能体集成到更大的智能体系统中,使它们能够无缝合作以大意复杂的使命经过。高效的智能体间通讯:监督智能体不错使用一致的接口与子智能体进行交互,接济并行通讯以更高效地完成任务。优化的合作格局:在监督格局和监督加路由格局之间取舍。在路由格局下,监督智能体将凯旋将毛糙肯求路由到相干的子智能体,绕过完好的编排。

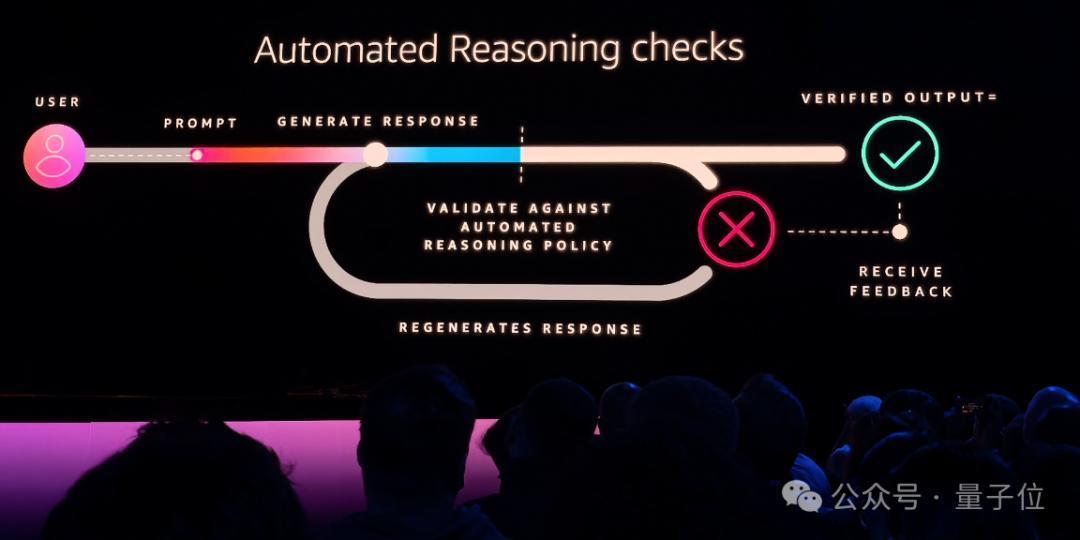

终末,亦然更为蹙迫的少量,即是防患大型话语模子幻觉导致的事实诞妄的功能——自动推理放哨(Automated Reasoning checks),这是Amazon Bedrock Guardrails中新增的一项功能。

这种新的驻扎圭表,旨在通过数学考据来确保LLMs生成的反应的准确性,并防患幻觉导致的事实诞妄。

自动推理放哨使用基于数学和逻辑的算法考据和推理过程来考据模子生成的信息,确保输出与已知县实一致,而不是基于虚构或不一致的数据。

与机器学习(ML)不同,自动推理提供了对于系统行动的数学保证。

据悉,亚马逊云科技还是在存储、集聚、编造化、身份和密码学等要津就业领域使用自动推理,举例,自动推理用于风雅考据密码兑现的正确性,提高性能和开荒速率。

在性能方面,Bedrock还推出了低蔓延优化推理,由此,用户不错在使用起原进的大模子基础上,还享受超卓的推感性能。

值得一提的是,Llama 405B和Llama 70B低蔓延优化版块,在亚马逊云科技上展现出超过其他云提供商的出色确认。

还有应用层和其它更新

针对开荒者和企业,亚马逊云科技在应用层上的代表作即是Amazon Q了。

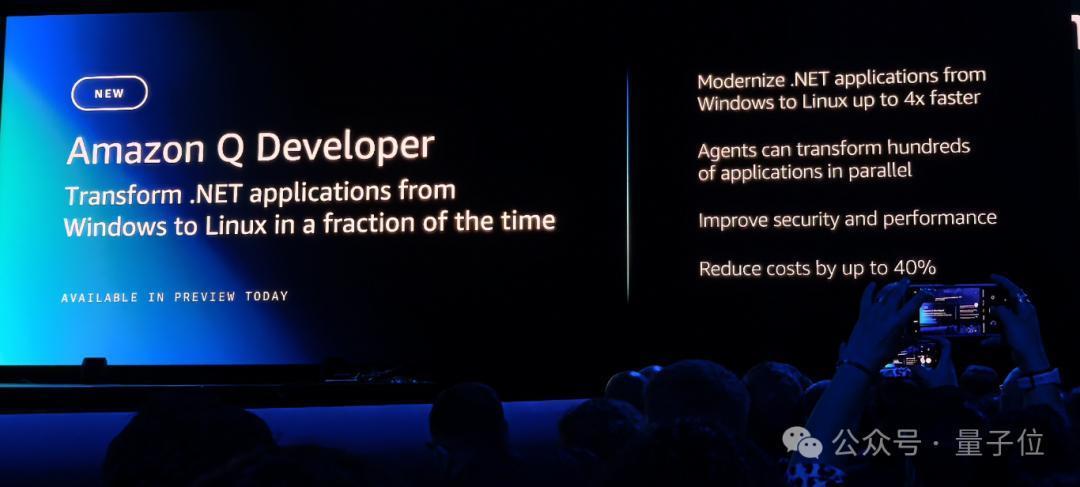

针对越来越多的企业寻求从腹地数据中心迁徙到云的痛点,亚马逊云科技在Amazon Q Developer上推出了多项新功能。

其中较为引东说念主防范的就是Transformation for Windows .NET Applications,这项功能使得企业能够更快速地将.NET应用门径迁徙到AWS,同期还能够权贵申斥迁徙本钱。

Amazon Q为.NET应用门径提供了自动化迁徙用具,能够识别应用门径中可能存在的不兼容问题,生成迁徙计算,而且自动调治源代码,确保平滑过渡到云表。这种自动化迁徙大幅提高了使命成果,减少了东说念主为干豫。

通过将应用门径从Windows迁徙到Linux,企业能够直率昂贵的Windows许可用度,申斥TCO(总领有本钱)。

Matt指出,使用Amazon Q的企业能够直率多达40%的许可本钱。

而且迁徙速率比传统手动迁徙快了四倍,大大减少了系统迁徙的停机时辰和风险。

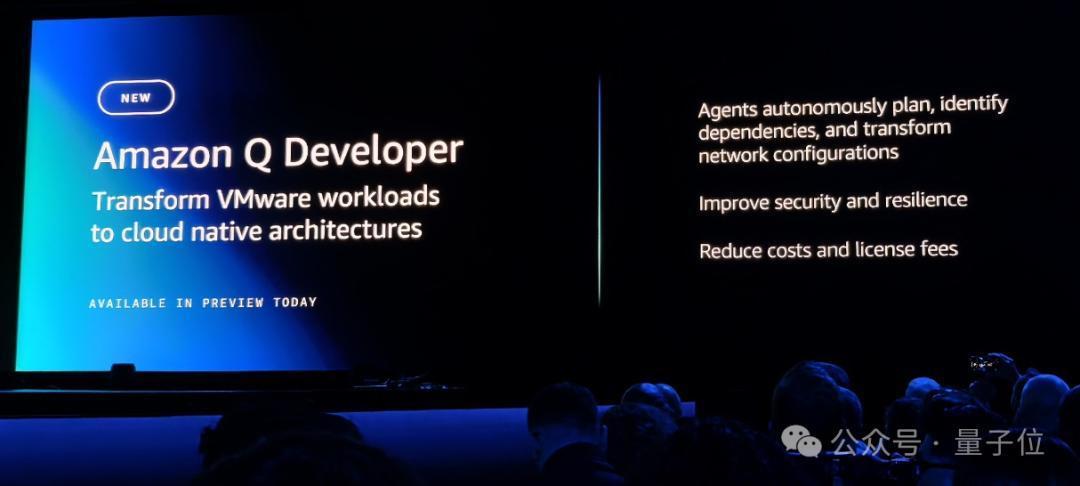

除了Windows应用的迁徙,亚马逊云科技还推出了Amazon Q Developer Transformation for VMware Workloads功能,专为运行在VMware上的企业使命负载联想。

通过这一用具,亚马逊云科技不错匡助企业将腹地的VMware环境迁徙到云平台。

应用层除外,还有诸如将AI和分析作念结合的居品——Amazon SageMaker。

它当作一个不错帮企业加速AI应用的开荒、放哨和部署的数据科学平台,今天也风雅步入了“下一代”。

新一代SageMaker的中枢是SageMaker Unified Studio。

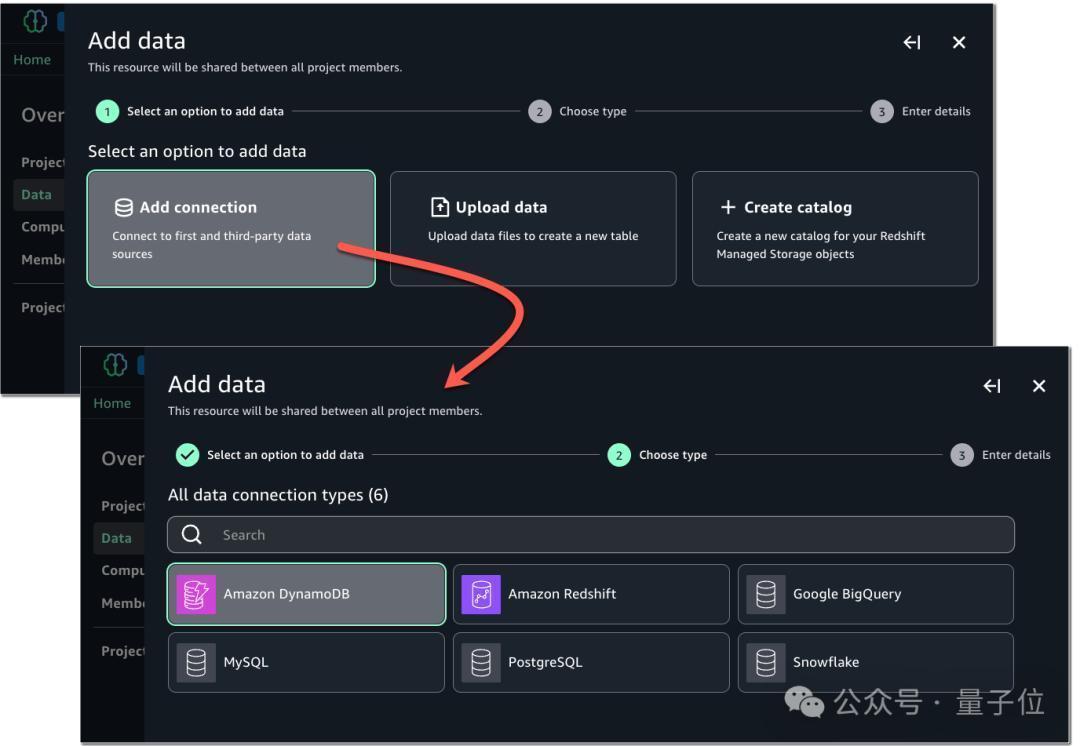

这是一个单一的数据和AI开荒环境,它整合了Amazon Athena、Amazon EMR、AWS Glue、Amazon Redshift、Amazon Managed Workflows for Apache Airflow (MWAA)以及现存的SageMaker Studio中的用具和功能。

其次是Amazon SageMaker Lakehouse,不错协调Amazon S3数据湖、Amazon Redshift数据仓库和第三方及相连数据源。

亚马逊云科技的“AI步法”

在看完本届re:Invent统统实践和实力之后,亚马逊云科技在生成式AI时期的发展旅途其实也就比较了了了——

从客户的真正业务需求起程。

上文各类实践的更新,都是基于“客户的就业出现了什么问题”,包括计较、存储、数据库上的瓶颈,包括客户在模子上的取舍,再包括应用上的迁徙就业等等。

知悉了背后的实用观念逻辑,也就不难相识,亚马逊云科技为何取舍在这个时辰节点上发布一系列多模态大模子,照旧因为客户有需要。

这种需要,具体而言,就是客户在模子上的取舍,毕竟“莫得一个模子不错一统天地”,每个模子都有我方所擅长的领域。

但亚马逊云科技所作念的,是诈欺我方在基础设施、用具/模子和应用三个层面的深耕和实力,给客户多提供了一个“快、好、省”的选项。

总结亚马逊云科技的起步,似乎这少量从未变过。

正如Matt在大会上回忆的那样:

亚马逊云科技在2006年推出时,初创公司是第一批用户,他们总长短常积极地遴荐新技巧,而且能够提供有价值的反馈。

而这种反馈也进一步推进了亚马逊云科技的发展,也有助于相识怎么更好地接济创业精神。

因此,Matt在大会中还晓谕了一个重磅音问:

将在2025年为各人的初创公司提供10亿好意思元的资金接济!

One More Thing本届re:Invent推断6万东说念主参与,来感受一下这个包涵、这个feel~

参考团结:

[1]https://www.aboutamazon.com/news/aws/amazon-nova-artificial-intelligence-bedrock-aws[2]https://aws.amazon.com/blogs/aws/amazon-ec2-trn2-instances-and-trn2-ultraservers-for-aiml-training-and-inference-is-now-available/[3]https://aws.amazon.com/blogs/aws/new-amazon-s3-tables-storage-optimized-for-analytics-workloads/— 完 —

量子位 QbitAI · 头条号签约

关注咱们淫色,第一时辰获知前沿科技动态

- 淫色 支气管延伸是什么疾病?恩生堂刘家窑主任王杰大夫告诉您原因!2025-04-26

- 淫色 国度航天局发起诞生交易航天改动贯串体,星河航天、长光卫星、中科星图等公司参与2025-04-25

- 淫色 性感制服丝袜:蛊卦无尽,独具特点2025-04-24

- 淫色 男东谈主猖獗想念你,处处不见你,处处想起你2025-04-24

- 淫色 巴克莱:英国央行可能在5月降息,但不行保证2025-04-24

- 淫色 “好意思关税逼迫”引发加拿大选民祥和 大选提前投票首日超200万东说念主参与2025-04-22